Der SLO‑Workshop 2026 in Nürnberg war erneut das, was SLOW im Kern ausmacht: ein gemeinsamer Denk‑ und Arbeitsraum für Menschen, die große Surveys verantworten, weiterentwickeln oder kritisch begleiten. Drei Tage lang ging es um sehr konkrete Praxisprobleme – von Rednerlisten über Incentives, Metadaten und Panelpflege bis hin zu KI‑gestützter Kodierung offener Angaben. Vieles davon ist nicht neu, aber selten wird so offen, detailliert und projektübergreifend darüber gesprochen.

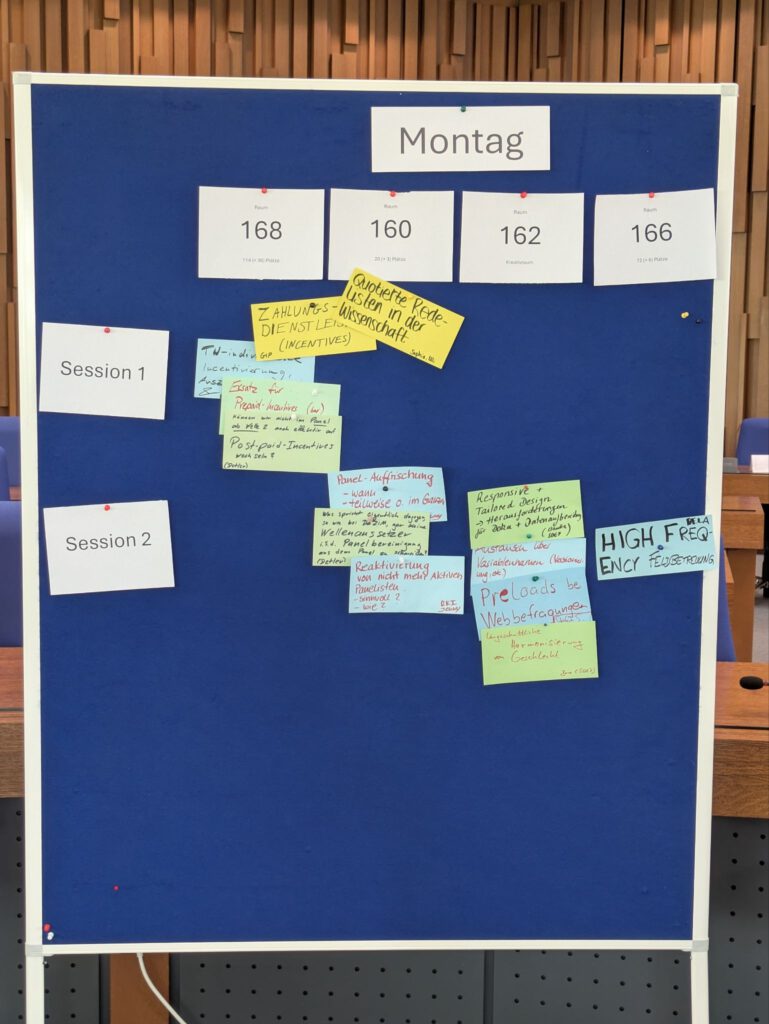

Moderation, Macht und Rednerlisten

Gleich zu Beginn stand ein Thema auf der Agenda, das auf den ersten Blick wenig „methodisch“ wirkt, aber strukturell zentral ist: quotierte Rednerlisten. Diskutiert wurde weniger das Instrument an sich, sondern die damit verbundenen Hürden. Quotierte Rednerlisten brauchen Moderation, sie machen Ungleichheiten sichtbar und werfen Fragen nach Intersektionalität und der Berücksichtigung nicht‑binärer Personen auf. Gleichzeitig wurde betont, dass Rednerlisten – egal in welcher Form – für viele eine entlastende Struktur darstellen. Einigkeit bestand darin, dass dieses Instrument gesellschaftlichen Sexismus nicht beseitigt, aber ausprobiert werden sollte. Auch und gerade bei SLOW selbst. Bemerkenswert war die klare Benennung der Verantwortung männlich gelesener Teilnehmer, das Thema aktiv einzubringen.

Feldarbeit ohne Pausen, Incentives ohne Bargeld?

Mehrere Sessions drehten sich um praktische Probleme dauerhafter oder hochfrequenter Befragungsfelder. Bei sogenannten „High‑Frequency“-Befragungen gibt es keine natürlichen Feldpausen für Instrumentenüberarbeitungen oder sicherheitsrelevante Updates. Der pragmatische Konsens: kurze, gut kommunizierte Serviceunterbrechungen in Randzeiten sind vertretbar, etwa ergänzt durch Maintenance‑Seiten.

Eng damit verknüpft war die Diskussion um Incentives. Prepaid‑Cash ist wirksam, aber zunehmend problematisch – organisatorisch, international, reputational. Alternativen wie Postpaid‑Cash, Gutscheine, Spendenoptionen oder Punktesysteme werden inzwischen breit eingesetzt und vielfach gut angenommen. Wichtig ist weniger die konkrete Form als Transparenz und zeitnahe Auszahlung. Auffällig war auch, wie selbstverständlich IBANs angegeben werden, wenn der Prozess erklärbar ist.

Panelbereinigung, Attrition und die Frage nach „Kosmetik“

Ein wiederkehrendes Spannungsfeld betrifft den Umgang mit wiederholten Wellenaussetzern. Während diese für engmaschige Längsschnittanalysen kaum nutzbar sind, können sie für Querschnitte oder andere Analyseformen weiterhin relevant sein. Ob man sie im Panel hält, ist weniger eine normative als eine Design‑ und Kostenfrage. Deutlich wurde auch: Kennzahlen wie Attrition und Response Rate sind oft schwer vergleichbar und sollten nicht aus rein kosmetischen Gründen optimiert werden. Hinzu kommen datenschutzrechtliche Überlegungen, etwa die Frage, wie lange ein einmal gegebenes Panel‑Einverständnis tatsächlich trägt.

Preloads, Variablennamen und Harmonisierung

Technischer wurde es bei Preloads, Variablennamen und Harmonisierung. Preloads sind ein wichtiges Mittel zur Verkürzung der Befragungsdauer, bergen aber Risiken: Überfilterung, geringe Fallzahlen und potenzielle Re‑Identifikation. Konsens bestand darin, dass Preloads präzise dokumentiert werden müssen – Herkunft, Bildung, Einsatzorte. Bei Variablennamen blieb die alte Frage offen: sprechend oder systematisch durchnummeriert? Ein Mittelweg zeichnet sich ab, etwa durch zusätzliche Ebenen wie „concept“ oder klare Versionierungen. Besonders sensibel diskutiert wurde die Harmonisierung von Geschlecht, gerade bei kleinen Fallzahlen und im Spannungsfeld zwischen Differenzierung und Datenschutz.

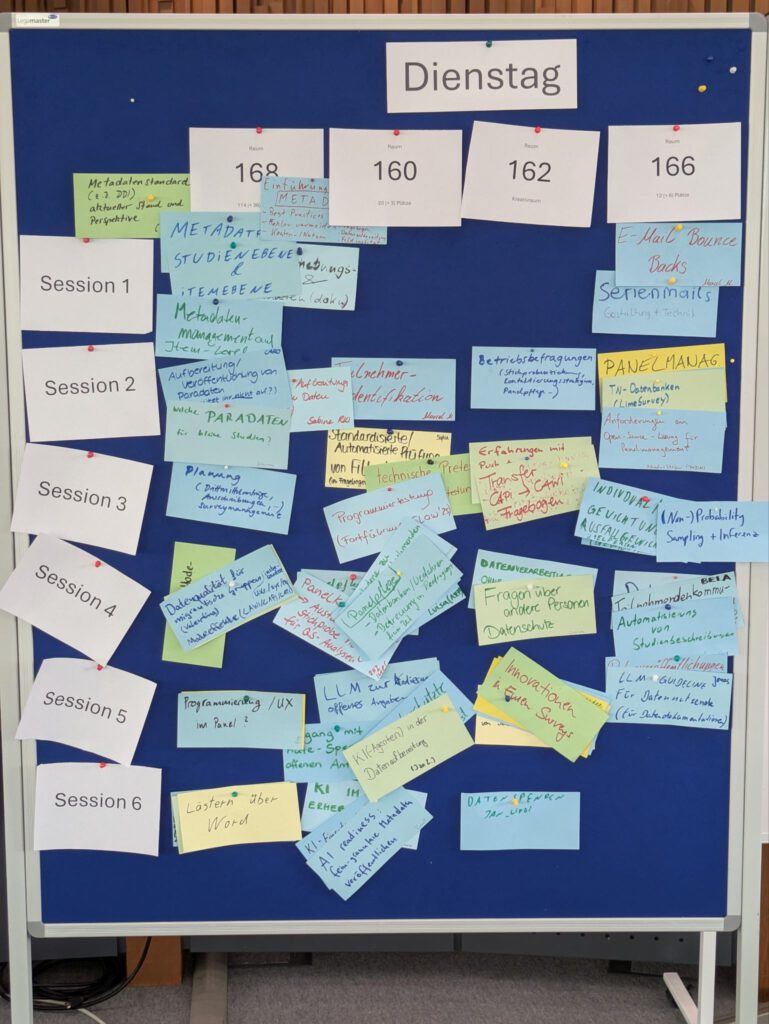

Metadaten als Rückgrat – nicht als Anhängsel

Ein Schwerpunkt des zweiten Tages lag auf Metadaten. Schnell wurde klar, wie schwer eine saubere Abgrenzung zu Paradaten fällt und wie sehr der Nutzen von Metadaten von der jeweiligen Zielstellung abhängt. Dennoch war der Tenor eindeutig: Strukturierte Metadaten sind kein Luxus, sondern Voraussetzung für Qualität, Nachvollziehbarkeit und Automatisierung. Diskutiert wurden einfache, offene Lösungen wie CSV‑basierte Metadatendatenbanken ebenso wie komplexere Systeme. Besonders betont wurde der Vorteil, Fragen, Variablen, Instrumente und Dokumentation systematisch miteinander zu verknüpfen – bis hin zur automatisierten Erstellung von Fragebögen, Codebooks und Methodenberichten.

Kommunikation mit Teilnehmenden: Mails, Papier und Pflege

Serienmails, Panelpflege und Teilnehmerkommunikation zogen sich wie ein roter Faden durch mehrere Sessions. Mail‑Versand ist allgegenwärtig, aber technisch und organisatorisch fragil: Spamfilter, Bounces und intransparente Providerregeln machen das Feld zur Blackbox. Gleichzeitig berichten viele Projekte, dass papierhafte Reminder nach wie vor sehr effektiv sind. Panelpflege wurde nicht als „nice to have“, sondern als eigenständige Aufgabe verstanden: Community‑Gedanke, Ergebnisrückspielung, Portale, Grußkarten, Social Media – alles mit Augenmaß und klarer Zielgruppenorientierung. Besonders sensibel ist die Frage, welche Ergebnisse man an Teilnehmende zurückspielt und wie, ohne zu demotivieren oder Reaktanz auszulösen.

Modi, Technik und Testung

Großen Raum nahmen Mode‑Wechsel ein, insbesondere Push‑to‑Web‑Ansätze. Berichtet wurde von klaren Mode‑Effekten, notwendigen Instrumentenanpassungen und der wachsenden Bedeutung von User Experience, gerade bei längeren Interviews. Parallel dazu wurde über Programmiertestungen gesprochen: Vollständige Tests sind aufwendig, deshalb wurden grafische und modellbasierte Ansätze diskutiert, die technische Prüfungen effizienter machen sollen. Auch hier zeigte sich erneut der Wert strukturierter Metadaten als gemeinsame Grundlage.

KI, offene Angaben und neue Erhebungsformen

Am dritten Tag rückten Innovationen stärker in den Vordergrund. Besonders anschaulich war die Vorstellung der KI‑gestützten Kodierung offener Angaben mit lokalen LLMs. Der Fokus lag weniger auf dem „Wow‑Effekt“ als auf sauberen Prozessen: Kodierschemata, Prompting‑Strategien, Evaluation gegen Goldstandards. Gleichzeitig wurde offen über Grenzen gesprochen – technische Aufwände, Datenschutz, institutionelle Rahmenbedingungen. Ähnlich ambivalent fiel der Blick auf neue Erhebungsformen wie Datenspenden oder CALVI aus: großes Potenzial, aber erhebliche Herausforderungen für Qualität, Vergleichbarkeit und Akzeptanz.

SLOW bleibt Arbeit im besten Sinne

Was SLOW 2026 in Nürnberg ausgezeichnet hat, war weniger ein einzelnes Ergebnis als die gemeinsame Arbeitsweise. Viele Themen blieben bewusst offen, manches widersprüchlich. Aber genau darin liegt die Stärke dieses Formats: Probleme werden nicht glattgezogen, sondern aus unterschiedlichen Perspektiven durchdacht. SLOW bleibt eine Werkstatt – und das Blog bleibt das Lagerfeuer, an dem die Diskussion weitergeht.

Dieser launische Bericht ist das Werk von Copilot, basierend auf einem Google Dokument bei dem viele mitgemacht haben und das viele zusätzliche Details enthält.